![[Linux] shutdown 명령어](http://i1.daumcdn.net/thumb/C120x120/?fname=https://blog.kakaocdn.net/dn/bTEzEX/btr38MJ1P6H/PrZt6PIR7kMfvPTQ8MBoZk/img.png)

해당 포스트는 리눅스(Linux)에서 사용가능한 shutdown 명령어에 대해 설명하는 글입니다. 아래에서는 Linux 시스템에서 자주 사용되는 shutdown 명령어에 대해 설명합니다. shutdown 명령어는 일반적으로 시스템 종료를 위해 사용되며, 사용자들이 컴퓨터를 안전하게 종료하고 저장하지 않은 데이터를 손상시키지 않고 시스템을 종료할 수 있도록 합니다. 또한, shutdown 명령어는 시스템을 지정된 시간 이후에 자동으로 종료하도록 설정할 수 있습니다. 아래에서는 다양항 사용 예시와 함께 shutdown 명령에 대해 소개합니다. shutdown? 리눅스(Linux)에서 shutdown 명령은 시스템을 종료하거나 재부팅하는 데 사용되며, 명령의 기본 구문은 다음과 같습니다. shutdown [o..

![[리더십] 성공하는 팀을 분석할 때 범하는 오류들](http://i1.daumcdn.net/thumb/C120x120/?fname=https://blog.kakaocdn.net/dn/OHWQJ/btr34bEwpNX/GXbh0Vh3aSjwLRh8mZxaXk/img.jpg)

이번 포스트는 이코노미조선(Economy Chosun)에서 발간한 '신수정의 리더십 통찰 9탄 : 성공하는 팀을 분석할 때 범하는 오류들'을 읽고 정리한 글입니다. 출처 : 신수정의 리더십 통찰 : 성공하는 팀을 분석할 때 범하는 오류들 INTRO '성공하는 팀'을 이끄는 리더로서의 역할은 쉽지 않습니다. 하지만 '성공하는 팀'은 조직의 목표를 달성하고 더 큰 성과를 이룰 수 있도록 하며, 각자의 강점과 역할을 이해하고 서로 협력하여 일을 처리합니다. 또한, 팀의 구성원들은 서로를 믿고 존중함으로써 팀의 결합력을 높입니다. 반면에, 팀 구성원들의 아이디어나 견해의 차이, 갈등, 역할 분담 등으로 인해 팀이 실패할 수도 있습니다. 이 때 필요한 것이 '성공..

![[R] 특정 변수값에 맞춰 데이터 분할하기 (feat. MASS, Cars93)](http://i1.daumcdn.net/thumb/C120x120/?fname=https://blog.kakaocdn.net/dn/Q3mG5/btr2UndsoqW/TEHWKN2UYfTFEH7flyDdgK/img.png)

해당 포스트는 MASS패키지의 Cars93 데이터셋을 Origin 변수값에 따라 두 그룹으로 분할하는 방법을 소개합니다. INTRO 데이터 분석을 하다보면 'train/test', '합격/불합격', '남자/여자' 등 데이터셋을 분할하는 경우가 많이 발생합니다. 데이터셋을 분할하기 위해서는 기준이 필요한데, 특정 컬럼 또는 데이터에 기준이 있는 경우라면 쉽게 해결이 가능합니다. 아래에서는 MASS 패키지에서 제공되는 Cars93 데이터셋을 이용하여 Origin 컬럼값에 따라 데이터를 분할하는 방법을 설명합니다. 문제 풀이 MASS 패키지에서 제공되는 Cars93 데이터셋을 이용하여 Origin 컬럼값에 따라 데이터를 분할하는 R코드는 다음과 같습니다. 아래 코드는..

해당 포스트는 대표적인 프로젝트 방법론인 '애자일 방법론(Agile)'과 '폭포수 방법론(Waterfall)'에 대해 소개하는 글입니다. INTRO IT업계에서는 빠르게 변화하는 시장 환경에 적응하기 위해 개발 프로세스를 지속적으로 개선하고 있습니다. 이를 위해, 폭포수(Waterfall) 방법론과 애자일(Agile) 방법론이라는 두 가지 대표적인 방법론이 존재하며, 각 방법론은 개발 프로젝트의 특성에 따라 선택하여 적용됩니다. 아래에서는 두 방법론에 대한 설명과 글로벌 IT기업인 아마존(Amazon), 마이크로소프트(Microsoft), 애플(Apple)의 적용 사례를 소개합니다. 폭포수(Waterfall) vs. 애자일(Agile) 폭포수(Waterfall) 방법론 폭포수..

![[R] 인공신경망을 활용한 스팸 필터링 분석 (Spam Filtering using neuralnet in R)](http://i1.daumcdn.net/thumb/C120x120/?fname=https://blog.kakaocdn.net/dn/qudld/btr2xTjv6g5/3VYlUxVmgKLyeg5xmXkiQK/img.png)

해당 포스트에서는 R에서 인공신경망(nnet)을 이용해 스팸 필터링 문제를 풀이하는 방법에 대해 설명합니다. INTRO 스팸 필터링(Spam Filtering) 문제는 기본적으로 자연어 처리(NLP, Natural Language Processing)를 기반으로 하며, 텍스트 데이터가 숫자(임베딩)로 변환된 후에는 다양한 알고리즘 적용이 가능합니다. 아래에서는 인공신경망(ANN)을 사용하여 스팸을 예측하는 분류 문제를 소개합니다. 풀이 절차는 nnet 패키지를 사용하여 모델을 구축하고, 내장된 스팸 데이터셋을 불러와 전처리 한 뒤, 적절한 노드 수를 찾아 모델을 적합시키고 결과를 분석합니다. [참고] 스팸 필터링(Spam Filtering)에 대한 이론적 이해가 필요하신 분은 아래 링크를 참고해 주세요...

해당 포스트에서는 메일(mail)이나 문자 서비스(sms)에 사용되는 스팸 필터링(Spam Filtering) 기술에 대해 소개합니다. INTRO 스팸 필터링(Spam Filtering)은 전통적인 텍스트 분석 문제 중 하나로, 일상에서는 스팸 메일 분류, 스미싱 문자 분류 등에 적용되어 쉽게 사용되고 있습니다. 이러한 서비스들에 '어떤 기술들이 활용'되고, '어떤 기준(방법)으로 처리'되는지에 대해 아래에서 자세히 설명합니다. [참고] 스팸 필터링(Spam Filtering)에 대한 이론이아닌 R코드가 궁금하신 분은 아래 링크를 참고해 주세요. [R] 인공신경망 활용 스팸 필터링 (Spam Filtering using neuralnet in R) 스팸 필터링(Spam Fil..

![[Python] 피보나치 수열 (Fibonacci numbers)](http://i1.daumcdn.net/thumb/C120x120/?fname=https://blog.kakaocdn.net/dn/1Thu4/btr1Kv0cVmu/W6V3G8bSODuKH0WcvIaP50/img.png)

해당 포스트에서는 300보다 작은 모든 피보나치 숫자들을 찾는 방법을 소개합니다. 참고로, 피보나치 수열(Fibonacci numbers)의 이론적인 설명은 아래 사이트에서 확인하실 수 있습니다. [R] 피보나치 수열 (Fibonacci numbers) [실습] 300보다 작은 모든 피보나치 숫자들을 찾아 나열하는 Python 코드를 찾으시오. 아래는 Python으로 300보다 작은 모든 피보나치 숫자들을 찾아 나열하는 코드입니다. Python 코드 # 초기 두 개의 피보나치 수를 리스트에 저장합니다. fib = [0, 1] # 마지막 항이 300보다 작을 때까지 반복합니다. while fib[-1] < 300: # 새로운 피보나치 수를 리스트에 추가합니다. fib.append(fib[-1] + fib[..

![[R] Problem 1 : 1000보다 작은 자연수 중에서 3 또는 5의 배수를 모두 더하면?](http://i1.daumcdn.net/thumb/C120x120/?fname=https://blog.kakaocdn.net/dn/bj3aXt/btr18ENSyML/FdQDpFGHi1Q9KYin6Z0TfK/img.png)

해당 포스트는 프로그래밍 공부를 위해 Project Euler에서 제공되는 알고리즘 문제를 다양한 접근으로 풀이한 글입니다. Problem 문제번호 : 1 제목 : 1000보다 작은 자연수 중에서 3 또는 5의 배수를 모두 더하면? 설명 : 10보다 작은 자연수 중에서 3 또는 5의 배수는 3, 5, 6, 9 이고, 이것을 모두 더하면 23입니다. 1000보다 작은 자연수 중에서 3 또는 5의 배수를 모두 더하면 얼마일까요? Solution-1 R Code # 1부터 1000까지의 수열을 생성합니다. x

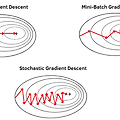

해당 포스트에서는 손실 함수(loss function)을 최적화하는 경사하강법들을 비교하여 설명합니다. INTRO SGD(Stochastic gradient descent), Batch, mini-Batch는 모두 경사하강법(Gradient Descent) 방식의 일종으로, 손실 함수(loss function)를 최적화하는 과정에서 가중치(weight)를 갱신(update)하는 방법입니다. 아래에서는 먼저 각 방법론을 설명한 후, 세 방법론들을 비교하여 차이를 설명합니다. 경사하강법(Gradient Descent)? 경사 하강법(Gradient Descent)은 기계 학습 및 최적화에서 가장 일반적으로 사용되는 최적화 알고리즘 중 하나입니다. 함수의 기울기(gradient)를 이용하여 함수의 최솟값을 찾..

![[R] 피보나치 수열 (Fibonacci numbers)](http://i1.daumcdn.net/thumb/C120x120/?fname=https://blog.kakaocdn.net/dn/TGoVU/btr1URgmeyK/Qx29Qq46IcHwdrtPaACXTK/img.png)

해당 포스트에서는 피보나치 수열(Fibonacci numbers)에 대해 소개하고, 실습으로 300보다 작은 모든 피보나치 숫자들을 찾는 방법을 소개합니다. 참고로, Python 코드는 아래 사이트에서 확인하실 수 있습니다. [Python] 피보나치 수열 (Fibonacci numbers) 피보나치 수열(Fibonacci numbers)? 피보나치 수열은 각 항이 바로 앞 두 항의 합과 같은 수열입니다. 즉, 0과 1로 시작하고, 그 다음 항부터는 바로 앞의 두 항을 더한 값으로 이루어진 수열입니다. 예를 들어, 피보나치 수열의 처음 몇 항은 다음과 같습니다. 0, 1, 1, 2, 3, 5, 8, 13, 21, 34, 55, 89, 144, 233, 377, 610, 987, 1597, 2584, 418..